win10用uefi启动更快吗?的详细介绍

【菜科解读】

专业的在线重装系统软件 全新设计 / 全新代码编写 / 全新支持所有机型 全新支持Window 11 安装如果您的新电脑使用的是UEFI而不是传统的BIOS,那么您的电脑会有更快的启动速度。

为了充分体验UEFI的优势,您需要在UEFI模式下正确的安装Win10系统。

下面小编来跟大家说说win10用uefi启动更快吗的详细介绍吧。

1、UEFI提供更大的磁盘容量。

传统MBR分区最大只能支持2.2TB的硬盘和4个主分区,而UEFI规范之一。

GPT分区格式,则可以支持过百TB大小的硬盘和100个主分区,对于使用win7的网友来说尤其有用。

而另一方面,在华硕、技嘉和希捷等厂商的努力下。

32位系统 加传统MBR分区也能通过“虚拟磁盘”之类形式使用2TB以上的硬盘,但是那当然不如UEFI加GPT的原生支持省力省心。

2、UEFI提供更高的效能。

传统BIos专为传统的16位解决器定制,寻址能力低下,效能表现很差;而UEFI可以适用于一点64位解决器,寻址能力强许多,效能表现优秀。

说白了就是加载更多硬件的同时更快地启动到windows。

3、64位新系统有优势。

从windows Vista sP1和windows server 2003开始,只要是64位的系统都能提供UEFI启动支持。

而XP系统、32位新系统,则只能通过UEFI的兼容模组实现开机。

4、更方便的批量安装。

配备UEFI的主板可以通过网络进行“广播式”安装,1个镜像广播给多台机一起安装操作系统,对企业网友来说尤其方便。

5、更快的开机、休眠恢复。

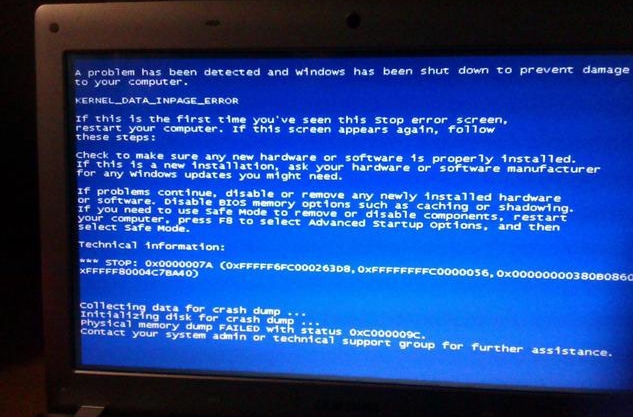

传统BIos使用Int 13中断读取磁盘,每次只能读64KB,非常低效,而UEFI每次可以读1MB,载入更快。

此外,微软的下一代操作系统win10,更是进一步优化了UEFI支持,据称可以实现瞬时开机。

以上就是win10用uefi启动更快吗的详细介绍啦,希望能帮助到大家。

不是AI淘汰你,是你用不起Token #AI #Token #技术变革

广告 不是AI淘汰你,是你用不起Token #AI #Token #技术变革 16:39 广告 广告 广告 了解详情 > 会员跳广告 首月9.9元 秒后跳过广告 开通搜狐视频黄金会员,尊享更高品质体验! 1080P及以上画质仅为黄金会员专享> 开通/续费会员 抱歉,您观看的视频加载失败 请检查网络连接后重试,有话要说?请点击 我要反馈>> 正在切换清晰度... 播放 按esc可退出全屏模式 00:00 00:00 04:07 广告 只看TA 高清 倍速 剧集 字幕 下拉浏览更多 5X进行中 炫彩HDRVIP尊享HDR视觉盛宴 高清 540P 2.0x 1.5x 1.25x 1.0x 0.8x 50 哎呀,什么都没识别到 反馈 循环播放 跳过片头片尾 画面色彩调整 AI明星识别 视频截取 跳过片头片尾 是 | 否 色彩调整 亮度 标准 饱和度 100 对比度 100 恢复默认设置 关闭 复制全部logDeepSeek-V4上线:使用华为芯片训练,性能比Gemini差3-6个月,价格优势明显

出品|搜狐科技 作者|郑松毅、常博硕 编辑|杨锦 DeepSeek V4,来了! OpenAI GPT 5.5 前脚刚发布,DeepSeek就亮出了“真家伙”。就在刚刚,DeepSeek-V4的预览版本正式上线并同步开源。

据官方介绍,DeepSeek-V4拥有百万字超长上下文,在 Agent 能力、世界知识和推理性能上均实现国内与开源领域的领先。

模型按大小分为两个版本: 更具产业里程碑意义的是,DeepSeek-V4 从模型设计之初就深度适配国产算力,在华为昇腾芯片生态实测跑通,成为全球首个在国产算力底座上完成训练与推理的万亿参数级模型,打破对海外芯片与框架的长期依赖。

性能比肩顶级闭源模型,价格比Claude便宜21倍 官方实测数据显示,DeepSeek-V4-Pro性能比肩顶级闭源模型。

Agent(智能体)能力方面,相比前代模型,DeepSeek-V4-Pro的能力显著增强。

在 Agentic Coding 评测中,V4-Pro 已达到当前开源模型最佳水平,并在其他 Agent 相关评测中同样表现优异。

DeepSeek介绍,目前 DeepSeek-V4 已成为公司内部员工使用的 Agentic Coding 模型,据评测反馈使用体验优于 Sonnet 4.5,交付质量接近 Opus 4.6 非思考模式,但仍与Opus 4.6 思考模式存在一定差距。

DeepSeek给出的结论相对克制。

在知识与推理任务上,其性能已经超过主流开源模型,并接近Gemini等闭源系统,但仍存在约3到6个月差距。

在 agent和代码任务上,其表现接近甚至部分超过Claude Sonnet。

此外,在数学、STEM、竞赛型代码的测评中,DeepSeek-V4-Pro超越当前所有已公开评测的开源模型(包括月之暗面的K2.6 Thinking、智谱GLM-5.1 Thinking等),取得了比肩世界顶级闭源模型的优异成绩。

相较之下,DeepSeek-V4-Flash主打性价比,能够提供更加快捷、经济的 API 服务。

在 Agent 测评中,DeepSeek-V4-Flash 在简单任务上与 DeepSeek-V4-Pro 旗鼓相当,但在高难度任务上仍有差距。

据悉,V4-Pro 与 V4-Flash 最大上下文长度为 1M,均同时支持非思考模式与思考模式,其中思考模式支持 reasoning_effort 参数设置思考强度(high/max)。

对于复杂的 Agent 场景建议使用思考模式,并设置强度为 max。

使用价格如下: DeepSeek表示,“受限于高端算力,目前Pro的服务吞吐十分有限,预计下半年昇腾950超节点批量上市后,Pro的价格会大幅下调。

” 再看看国际友商价格对比,可见DeepSeek的实惠: 混合架构解决工程落地痛点,全面适配国产算力 大模型处理超长文本的最大痛点,从来不是 “能不能装下”,而是跑不动、记不住、算不起。

随着传统注意力机制呈平方级复杂度攀升,百万Token场景下显存与算力直接 “爆炸”,几乎无法工程落地。

DeepSeek-V4 的发布,标志着大模型正式走出 “参数竞赛”,进入效率优先下一代赛道。

从一口气审计全量代码库、一次性解析千页合同,到全程记住长时间会议、串联多轮复杂智能体任务,V4让AI 真正具备“完整理解、长期记忆、深度推理”的能力,同时把使用成本大幅下拉。

这一切得益于DeepSeek业内首创“CSA (压缩稀疏注意力) + HCA (重度压缩注意力)”的混合架构。

用一套“分级压缩 + 分级检索”思路,把效率拉到极致。

这一新方法显著减少了计算复杂度,提升了长上下文处理的效率。

具体来看,CSA像给长文本做重点精读。

先把每 4 个Token压缩成一个信息块,再用稀疏检索只挑最相关的内容,既保留中段细节,又大幅削减计算量,兼顾精准与效率。

HCA像给长文本做大纲速读,把海量信息浓缩成框架级块,专门负责全局逻辑。

官方数据显示:1M Token场景下,V4-Pro 仅需 V3.2 的 27% 推理算力、10% KV 缓存;

Flash 版更是低至 10% 算力、7% 缓存。

除了混合注意力,V4 还带来三项关键技术革新,构成完整效率革命: mHC 流形约束超连接:升级传统残差连接,把信号传播约束在稳定流形上,深层不衰减、训练不炸数值。

Muon 优化器:替代传统 AdamW,收敛更快、训练更稳,完美适配 MoE 大模型与低精度训练,解决大批次长上下文训练的抖动难题。

全链路工程优化:专家并行细粒度通信重叠、TileLang 内核开发、FP4 量化感知训练、异构 KV 缓存管理,从计算、通信、存储全方位降本提速,推理加速最高近2倍。

最受大家关心的,是V4这次是否成功全面适配国产算力? 报告指出,DeepSeek-V4在英伟达 GPU 与华为昇腾 NPU 两大硬件平台上,对细粒度 EP 优化方案完成了全面验证。

相较于性能优异的非融合基线方案,该方案在通用推理负载场景下可实现1.50~1.73 倍的加速比。

有业内观点指出,这代表已经完成华为昇腾平台的适配和实测落地。

但目前对外开源的只有英伟达GPU版本,昇腾适配代码未开源,属于闭源适配优化。

值得一提的是,寒武纪在软硬一体生态中,已经完成基于 vLLM 推理框架完成对 285B DeepSeek-V4-flash 和 1.6T DeepSeek-V4-pro 的适配,适配代码已开源到 GitHub 社区。

剩下的,就等DeepSeek-V4的实用表现了。

还有DeepSeek的首轮融资最终花落谁家,也还是个谜题。

“不诱于誉,不恐于诽,率道而行,端然正己。

” DeepSeek官方在文章最后表示,他们将始终秉持长期主义的原则理念,在尝试与思考中踏实前行,努力向实现 AGI 的目标不断靠近。

”

猜你喜欢

-

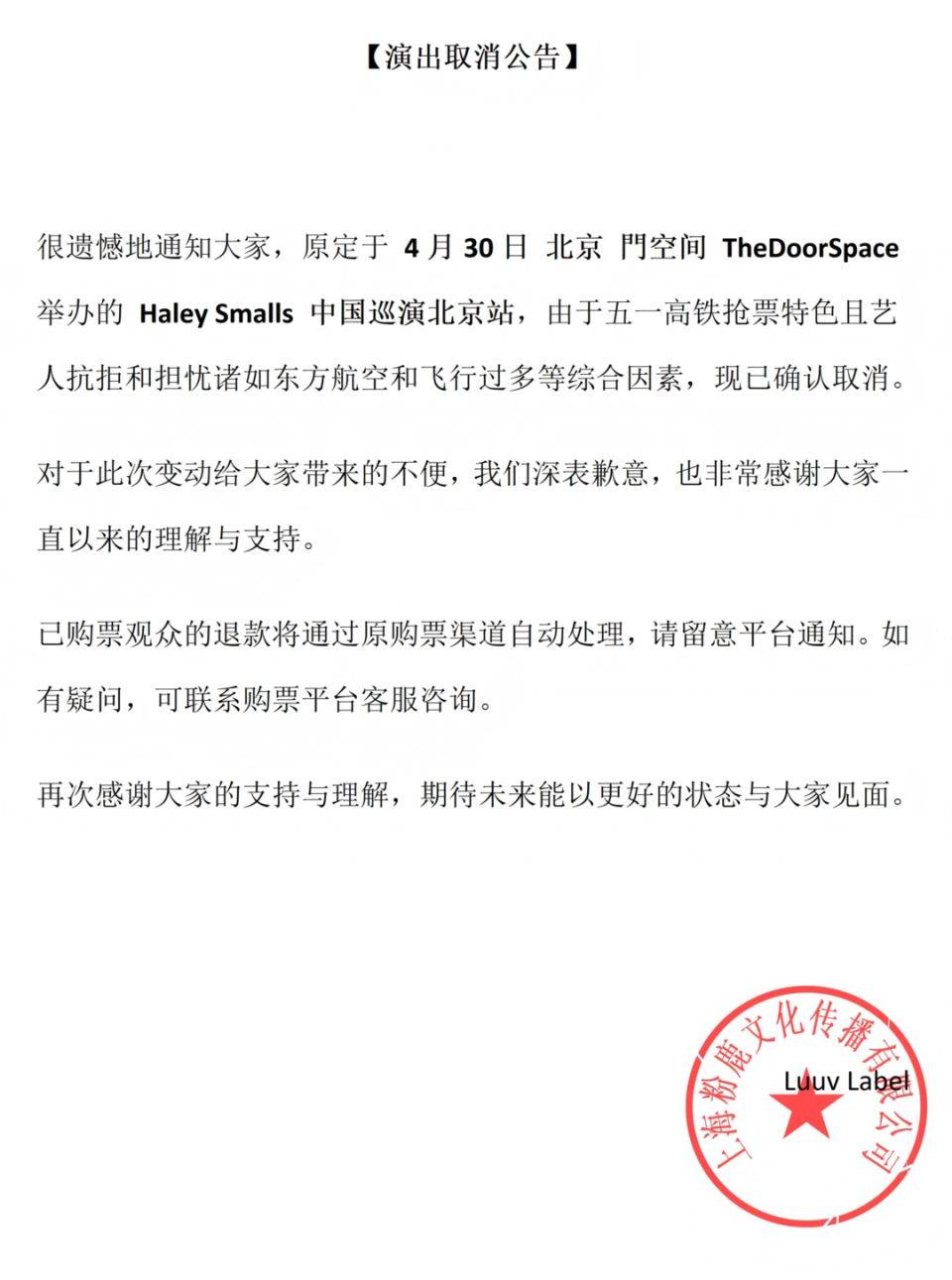

女歌手因抢不到“五一”高铁票取消演唱会:全额退款!主办方:她怕飞行过多 热点 2026-04-24

女歌手因抢不到“五一”高铁票取消演唱会:全额退款!主办方:她怕飞行过多 热点 2026-04-24 -

突发|华为诺亚方舟实验室主任王云鹤离职 热点 2026-04-24

突发|华为诺亚方舟实验室主任王云鹤离职 热点 2026-04-24 -

特朗普:不会对伊朗动用核武器,已“从军事上拿下了伊朗”!伊朗最高领袖、总统、议长、外长集体发声,否认“内斗” 热点 2026-04-24

特朗普:不会对伊朗动用核武器,已“从军事上拿下了伊朗”!伊朗最高领袖、总统、议长、外长集体发声,否认“内斗” 热点 2026-04-24 -

伊朗用“不怕死”三个字,劝退特朗普 热点 2026-04-23

伊朗用“不怕死”三个字,劝退特朗普 热点 2026-04-23 -

LexisNexis律商联讯发布起草法律文书功能,提升法律文书起草效率与可靠性 热点 2026-04-23

LexisNexis律商联讯发布起草法律文书功能,提升法律文书起草效率与可靠性 热点 2026-04-23 -

-

7月1日起全面铺开!湖南将迎来政策范围内住院分娩“零自付”时代 热点 2026-04-23

7月1日起全面铺开!湖南将迎来政策范围内住院分娩“零自付”时代 热点 2026-04-23 -

SOLAI发布AI智能体专用终端Solode Neo,售价369美元 热点 2026-04-22

SOLAI发布AI智能体专用终端Solode Neo,售价369美元 热点 2026-04-22 -

?怎么将U盘设置为第一启动项? u盘启动盘 2026-03-20

?怎么将U盘设置为第一启动项? u盘启动盘 2026-03-20 -

戴尔u盘启动设置为第一启动项的方法 u盘启动盘 2026-03-14

戴尔u盘启动设置为第一启动项的方法 u盘启动盘 2026-03-14 -

win10用uefi启动更快吗?的详细介绍 u盘启动盘 2026-03-14

win10用uefi启动更快吗?的详细介绍 u盘启动盘 2026-03-14 -

华硕电脑设置u盘启动为第一启动的方法 u盘启动盘 2026-03-14

华硕电脑设置u盘启动为第一启动的方法 u盘启动盘 2026-03-14